As ferramentas de inteligência artificial usadas para despir sem consentimento, foram criados para usar as mulheres como alvo. Estas "deepfakes" de cariz sexual não funcionam em homens.

A manipulação de imagens e vídeos para criar conteúdo de cariz sexual está mais próxima de ser considerada um crime perante todos os países da União Europeia.

A primeira diretiva sobre a violência contra as mulheres passará pela última fase de aprovação em abril de 2024.

Através de programas de inteligência artificial, estas imagens estão a ser manipuladas para despir mulheres sem o seu consentimento.

Mas o que muda com esta nova diretiva? E o que acontece se as mulheres que vivem na União Europeia forem vítimas de manipulações feitas em países fora da União Europeia?

As vítimas

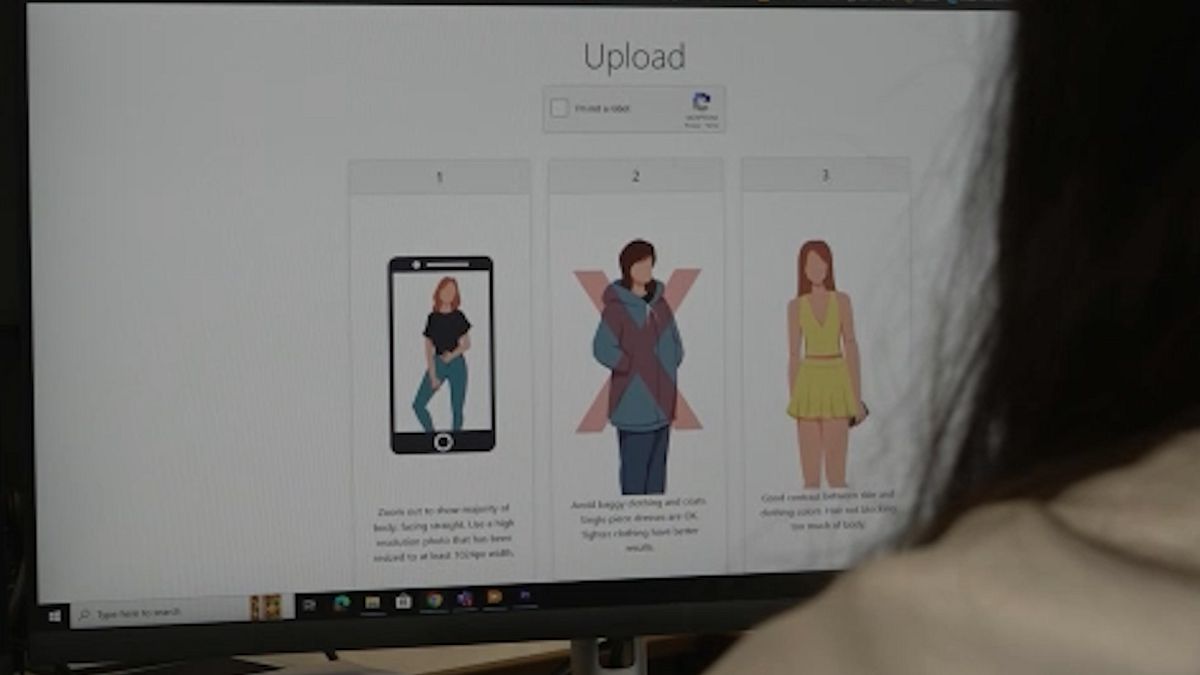

Os websites que permitem criar "deepfakes" de cariz sexual estão à distância de um clique em qualquer motor de busca e de forma gratuita.

A criação de uma "deepfake" de cariz sexual demora menos de 25 minutos e a custo zero, usando apenas uma fotografia em que o rosto se veja com clareza, segundo o estudo 2023 State of Deepfakes.

Na amostra de mais de 95 mil vídeos de "deepfakes" analisados entre 2019 e 2023, o estudo revela que houve um aumento 550%.

De acordo com Henry Ajder, especialista em inteligência artificial e "deepfakes", quem usa estas ferramentas procura "difamar, humilhar, traumatizar e, em alguns casos, gratificação sexual".

“E é importante referir que estas ferramentas usadas para despir não funcionam em homens. São especificamente criadas para usar as mulheres como alvo. É um bom exemplo em que a tecnologia é claramente maliciosa. Não há nada de neutro nisso”, acrescenta.

Os criadores de "deepfakes" sexualmente explícitas procuram as fotografias das vítimas "em todo o lado e em qualquer lugar".

"Podem ser da conta do Instagram, da conta do Facebook, da fotografia de perfil do WhatsApp", conta Amanda Manyame, consultora de direito e direitos digitais na Equality Now.

Prevenção

Quando as mulheres se deparam com "deepfakes" sexualmente explícitas suas, surgem dúvidas sobre a prevenção.

Contudo, a resposta não passa pela prevenção, mas sim pela rápida ação de remoção, segundo uma especialista em ciber-segurança.

"Estou a ver aquela tendência, que é natural, quando algum incidente como este acontece no digital, em que as pessoas dizem para não pormos as nossas fotografias online, mas tem a mesma lógica que dizer não saias à rua para não ter um acidente", começa por explicar Rayna Stamboliyska.

“Infelizmente, a ciber-segurança não consegue ajudar muito nestes casos, porque é tudo uma questão de desmantelar a rede de disseminação e, simultaneamente, remover o conteúdo,” a especialista em ciber-segurança acrescenta.

Atualmente, as vítimas de “deepfakes” sexuais dependem de um conjunto de leis como a lei de privacidade da União Europeia, o Regulamento Geral sobre a Proteção de Dados e leis nacionais sobre difamação para se protegerem.

Perante este tipo de crimes, as vítimas são aconselhadas a fazer uma captura de ecrã ou uma gravação em vídeo do conteúdo e a utilizá-las como prova, para denunciar à própria plataforma de redes sociais e à polícia.

A consultora de direito e direitos digitais na Equality Now acrescenta: "Também existe uma plataforma chamada StopNCII, ou seja, parar o abuso não-consentido da imagem privada, onde é possível denunciar se uma imagem nossa e, depois, o website cria o que é chamado um "hash" do conteúdo. Com a ajuda da IA, o conteúdo apaga automaticamente o conteúdo em várias plataformas."

Tendência global

Com esta nova diretiva proposta para combater a violência contra as mulheres, todos os 27 estados-membros terão o mesmo conjunto de leis para criminalizar as formas mais diversas de ciber-violência como as “deepfakes” sexualmente explícitas.

Contudo, fazer queixa deste tipo de crimes acaba por ser um processo complicado.

“O problema é que podemos ter uma vítima a viver em Bruxelas. O criminoso na Califórnia, nos Estados Unidos, e o servidor que contém o conteúdo talvez, vamos dizer, na Irlanda. Logo, torna-se um problema global, porque estamos perante diferentes países”, explica Amanda Manyame.

Perante esta situação, a eurodeputada sueca de centro-esquerda e co-negociadora principal do dossiê explica que "o que precisa de ser feito em paralelo com a diretiva" é um aumento da cooperação com outros países, "porque é a única forma de conseguirmos combater este crime que não vê qualquer fronteira.”

Evin Incir ainda admite: “Infelizmente, a tecnologia da Inteligência Artificial está a desenvolver-se muito rápido, o que significa que a nossa legislação precisa de acompanhar. Por isso, vamos precisar de rever a diretiva muito em breve. Mas isto é um passo importante para o estado atual, apesar de precisarmos de nos manter atualizados com o desenvolvimento da IA.”