Quase 200 vídeos do ICE gerados por IA obtiveram milhões de visualizações nas redes sociais, de acordo com dados partilhados com O Cubo.

A emissora pública alemã ZDF demitiu um correspondente nos EUA no final de fevereiro, depois de um vídeo gerado por IA ter aparecido numa reportagem sobre agentes da Imigração e Alfândega dos EUA (ICE).

PUBLICIDADE

PUBLICIDADE

PUBLICIDADE

PUBLICIDADE

A emissora pediu desculpas por usar o vídeo, que mostrava crianças agarradas à mãe enquanto ela era presa por agentes da ICE. O vídeo tinha uma marca d'água da Sora, uma indicação clara de que tinha sido criado pela ferramenta de vídeo da OpenAI.

A equipa de verificação de factos da Euronews, O Cubo, descobriu que o vídeo é um dos milhares de vídeos gerados por IA sobre agentes do ICE que estão a inundar as redes sociais, muitos sem identificação clara e acumulando coletivamente milhões de visualizações.

Padrão consistente

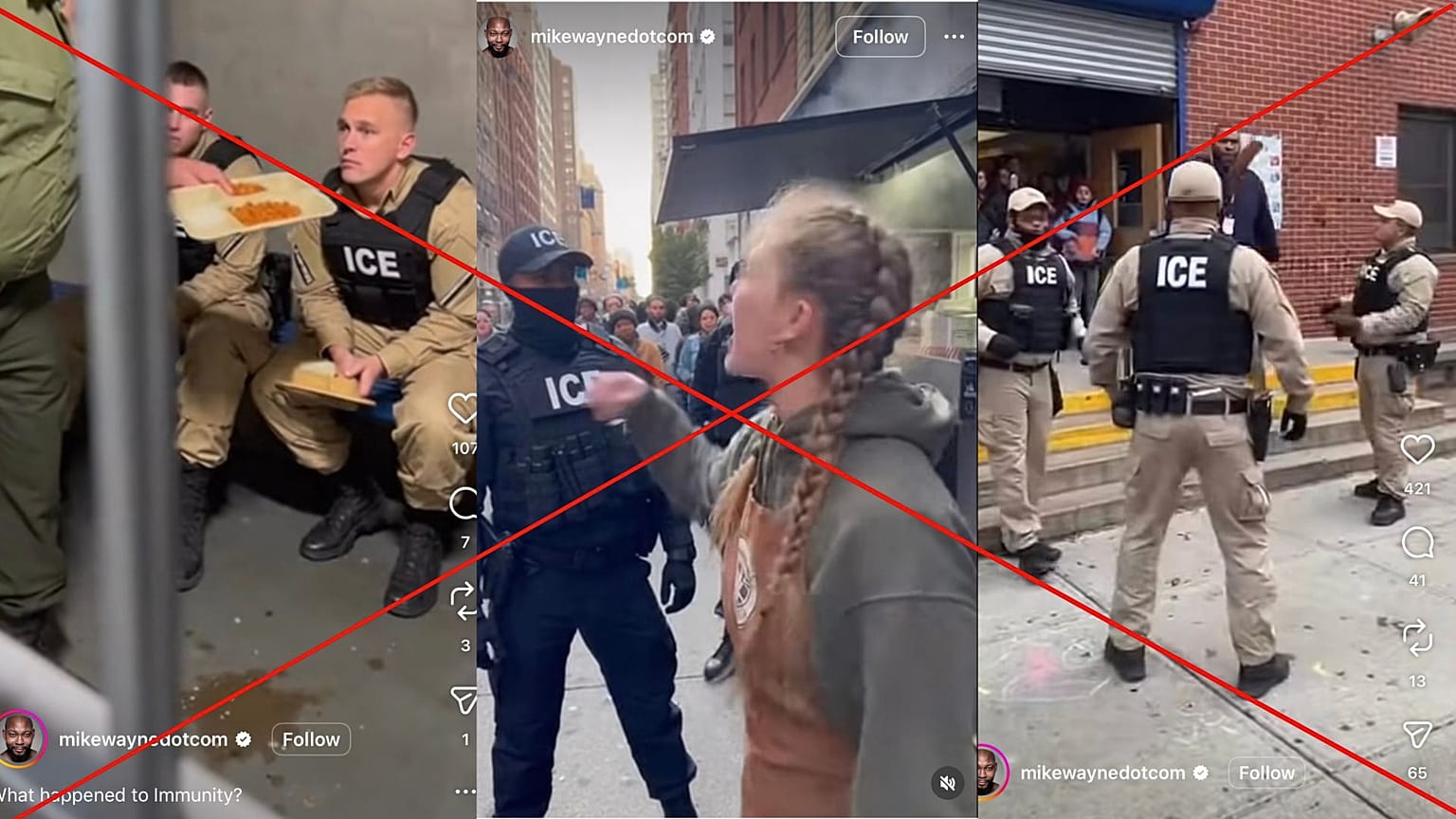

Os dados partilhados com O Cubo pela empresa de deteção de IA TruthScan mostram mais de 200 pequenos clips que retratam agentes do ICE a serem perseguidos por professores, a lutarem em bares e a serem detidos pelo NYPD (Departamento de Polícia de Nova Iorque) no metro.

A TruthScan disse que extraiu mais de 200 vídeos de uma única conta do Instagram. Os vídeos são curtos, dramáticos e emocionalmente carregados.

O Cubo descobriu que a conta continua a publicar clips do ICE gerados por IA em massa, com alguns a ganharem milhares e outros milhões de visualizações.

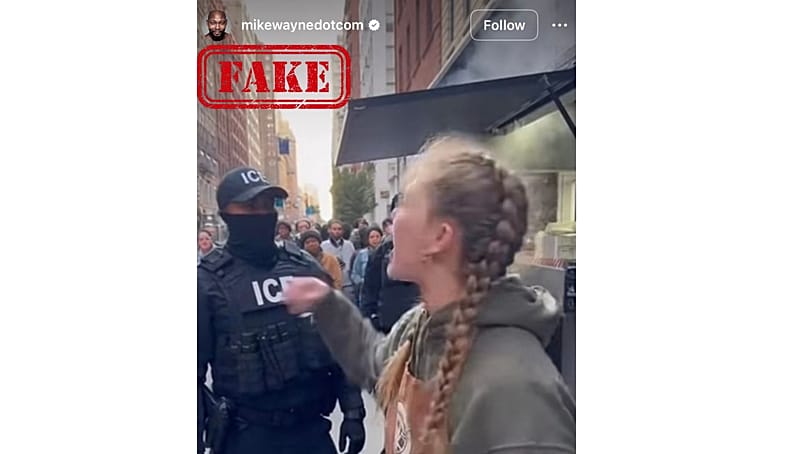

Há vários indícios de que os vídeos não são reais: num exemplo, o vapor parece subir através de uma superfície sólida durante um confronto entre um agente da ICE e uma funcionária de um café - um sinal subtil de que o vídeo é sintético.

De acordo com o TruthScan, cada vídeo tinha exatamente 10 ou 15 segundos de duração, o que sugere fortemente que foram gerados utilizando o modelo de vídeo Sora 2 da OpenAI, que oferece opções de vídeo de 10 ou 15 segundos aos utilizadores.

Ao contrário de muitos vídeos gerados por IA que contêm uma marca de água, a maioria destes clips de ICE não contém.

Do mesmo modo, em novembro do ano passado, a 404 Media informou que os clips gerados por IA de agentes do ICE provenientes de uma conta do Facebook se tornaram virais, tendo um deles gerado 4 milhões de visualizações. Os vídeos foram entretanto removidos.

Risco mais vasto para a confiança do público

Os especialistas afirmam que o risco não se limita à rotulagem incorreta de alguns vídeos, mas à proliferação de conteúdos falsos sobre questões políticas sensíveis, o que pode minar a confiança do público.

"Há um risco significativo para as respostas coletivas às ações das forças da ordem, tanto negativas como positivas", afirmou Ari Abelson, cofundador da OpenOrigins, uma empresa de verificação da autenticidade dos meios de comunicação social que deteta deepfakes.

"Esta é uma preocupação para as agências de aplicação da lei que pretendem manter a confiança do público, mas também para as instituições que as responsabilizam quando ultrapassam os limites", afirmou Abelson ao The Cube.

Tal como na emissão da ZDF, o conteúdo do ICE gerado por IA não se limita a contas anónimas. Por vezes, chega mesmo aos mais altos escalões de cargos públicos.

Em janeiro, a Casa Branca publicou uma fotografia digitalmente alterada da ativista e advogada Nekima Levy Armstrong, após esta ter sido presa durante um protesto relacionado com o ICE, no Minnesota.

Uma análise mostra que a imagem alterada retrata Armstrong com a pele mais escura e visivelmente a chorar, em comparação com a imagem original.

A Casa Branca respondeu às perguntas sobre a manipulação da imagem com uma mensagem do diretor-adjunto de comunicação, Kaelan Dorr, que dizia: "Mais uma vez, para as pessoas que sentem a necessidade de defender reflexivamente os autores de crimes hediondos no nosso país, partilho convosco esta mensagem: A aplicação da lei vai continuar. Os memes vão continuar".

Armston disse que estava "repugnada" com a Casa Branca por ter publicado a imagem.

De acordo com Abelson, a preocupação surge quando há falta de proteção - ou salvaguardas - para indicar claramente que o conteúdo é falso.

"As caricaturas políticas sempre foram utilizadas na política e estas estão a ser utilizadas de forma muito semelhante", afirmou. "A principal diferença é a forma hiper-realista como os vídeos se estão a tornar".

"Os espaços sociais e de informação exigem uma coisa: a capacidade de provar que uma fotografia e um vídeo são reais, para que possamos apreciar os falsos como ficções e sentir a gravidade dos acontecimentos da vida real", acrescentou.